“Come ammazzare il mio amico nel bel mezzo della lezione”. È la domanda choc che un ragazzino di 13 anni ha posto a ChatGgp durante l’orario scolastico. Pochi istanti dopo, non ha ricevuto una risposta dal chatbot, ma la visita della polizia, che lo ha arrestato. È accaduto a Deland, in Florida, e come facilmente prevedibile la notizia sta facendo in queste ore il giro del mondo, non solo per il gesto in sé del ragazzino ma anche per l’inquietante potere dei nuovi sistemi di sorveglianza digitale nelle scuole americane. Ora capirete perché.

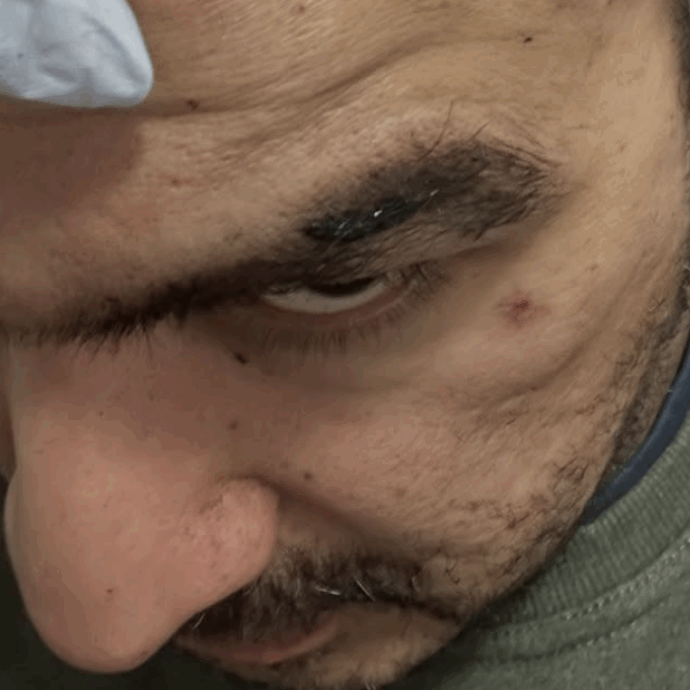

Tutto è successo il 26 settembre scorso alla Southwestern Middle School: a denunciare il ragazzo non è stato un insegnante né un compagno di classe, ma un’altra intelligenza artificiale. L’allarme è partito da Gaggle, una piattaforma di sicurezza scolastica che, come riportano i media americani, monitora le attività di quasi sei milioni di studenti negli Stati Uniti. Il software scansiona in tempo reale tutto ciò che passa attraverso gli account forniti dalla scuola: email, documenti, chat e, come in questo caso, persino le conversazioni con strumenti di intelligenza artificiale come ChatGpt. E’ stato così che il responsabile della sicurezza dell’istituto ha ricevuto una notifica su un prompt “a rischio” inserito da uno studente sul suo account scolastico e ha lanciato l’allarme. La polizia è intervenuta immediatamente e ha prelevato il 13enne dalla classe. Durante l’interrogatorio, il ragazzo si è giustificato dicendo che stava solo “trollando”, ovvero prendendo in giro un compagno di classe che lo stava infastidendo, spiegando che la richiesta a ChatGpt era solo uno “scherzo” e non una reale minaccia. “Un altro ‘scherzo’ che ha creato una situazione di emergenza nel campus”, ha dichiarato in una nota l’ufficio dello sceriffo della contea di Volusia lanciando un appello: “Genitori, parlate con i vostri figli affinché non commettano lo stesso errore”.

Le autorità non hanno minimizzato l’accaduto, anzi, tanto più in un Paese dove l’allerta per la violenza nelle scuole è sempre ai massimi livelli e dove la facilità di reperimento delle armi ha fatto sì che si verificassero sparatorie anche negli istituti scolastici. A finire nel mirino però è stato Gaggle, l’algoritmo addestrato a riconoscere parole chiave e “comportamenti preoccupanti” legati a violenza, autolesionismo o bullismo, che segnala automaticamente ogni potenziale minaccia all’amministrazione scolastica, fornendo anche screenshot del contesto. L’adozione di sistemi simili non è priva di controversie: critici e attivisti hanno sollevato preoccupazioni in merito alla privacy, all’eccessiva sorveglianza e al rischio di conseguenze. Fino a che punto è giusto sacrificare la privacy in nome della sicurezza, e chi controlla i controllori digitali che vegliano sulle vite di bambini e ragazzi?, è la domanda che rimbalza sui media americani.

Le critiche si concentrano infatti anche sull’affidabilità di questi sistemi: secondo un’inchiesta dell’Associated Press, in un distretto scolastico del Kansas, circa due terzi delle 1.200 segnalazioni inviate da Gaggle in 10 mesi sono state ritenute irrilevanti dai funzionari scolastici, generando un enorme numero di falsi allarmi. E non è l’unico sistema di controllo in uso negli Stati Uniti: altri software, come Lightspeed Alert, sono in grado di rilevare ciò che gli studenti stanno scrivendo prima ancora che premano invio. Una studentessa della Florida ha raccontato a People di due compagni che, dopo aver scritto minacce a un’insegnante e averle cancellate senza inviarle, sono stati prelevati dalla classe cinque minuti dopo, perché il sistema aveva già inviato l’allarme. Sembra un film di fantascienza, e invece è già la realtà.