Le vostre foto saranno dei capolavori di fantasia grazie al MIT

Gli esperti del Massachusetts Institute of Technology hanno messo a punto una tecnica basata su rete neurale che permette di automatizzare il processo di editing delle immagini, rendendolo più semplice al pubblico amatoriale e promettendo la possibile applicazione futura a livello professionale anche alle sequenze video.

Per capire di che cosa stiamo parlando basta un semplice esempio. Se siete andati alla mostra di Harry Potter, a Gardaland, a Disneyland o in un qualsiasi evento in cui è prevista la vendita di foto ricordo, avrete notato che i fotografi vi fanno posizionare davanti al “green screen”, una parete o un grande telo verde. Alla consegna della foto la vostra immagine sarà posizionata davanti a uno sfondo sensazionale, come per esempio la Luna o il Castello di Hogwarts.

Questo è possibile grazie al “compositing”, un processo di fusione delle immagini in primo piano e di sfondo che si fa con il computer. Nella maggior parte dei casi, guardando la foto da lontano il risultato è buono, stando a sottilizzare un po’ meno perché è molto difficile cogliere e sistemare a mano tutte le minime transizioni estetiche tra il soggetto in primo piano e lo sfondo. Pensate per esempio alla gestione di una folta capigliatura ricciola!

Finché si tratta di foto ricordo è un conto, ma queste tecniche vengono impiegate anche nei film, dove un risultato imperfetto è inaccettabile. Per questo ci sono editor che passano ore a correggere gli artefatti pixel per pixel, strabuzzando gli occhi per capire quali singoli pixel fanno parte dello sfondo e quali fanno parte di una persona specifica.

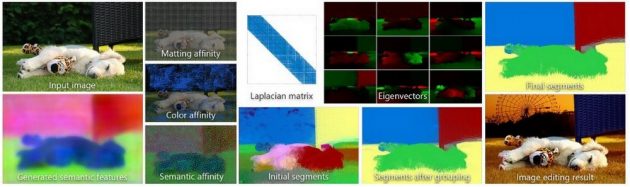

Qui entra in gioco il Semantic Soft Segmentation (SSS) sviluppato dal Computer Science e Artificial Intelligence Laboratory (CSAIL) del MIT. I ricercatori spiegano in un documento di aver trovato il modo di automatizzare parte di questo laborioso processo. Come? Usando tecniche di apprendimento automatico.

In buona sostanza la foto viene scomposta automaticamente in un insieme di livelli separati da una serie di “transizioni morbide”. Per chi mastica un po’ di fotoritocco, i livelli sono qualcosa di vagamente simile ai livelli di Photoshop. Il sistema analizza la texture e il colore di ciascun livello, quindi lo confronta con le informazioni raccolte da una rete neurale e propone una struttura grafica di transizione che incorpora caratteristiche di trama e colore dall’immagine. La chiave è quindi la generazione automatica di queste transizioni morbide, che viene effettuata tramite complessi concetti di algebra lineare con cui non vogliamo tediarvi.

A che cosa serve tutto questo alle persone comuni? Servirà per permettervi di montare senza sforzo e senza investimenti di tempo uno sfondo dietro a una vostra foto, anche se non siete dei prodigi della computer grafica. I vostri amici sui social avranno del filo da torcere per capire se la foto sia vera o no!

In secondo luogo, benché al momento questo lavoro sia focalizzato sulle immagini statiche, secondo i ricercatori in futuro si potrà usarlo anche per le sequenze in movimento, con applicazioni facili da immaginare nell’ambito della produzione cinematografica. Speriamo che presto la ricerca del MIT si trasformi in un prodotto di mercato.