Sviluppato un robot in grado di immaginare il proprio corpo e capace di relazionarsi con la sua immagine

“Specchio, specchio delle mie brame, chi è il robot più bello del reame?”. Fortunatamente non dovremmo neanche essere lontanamente vicini a robot che si osservano con occhio da Narciso allo specchio o che passano la giornata con una selfie stick. Ma certo impressiona la notizia che arriva da oltreoceano relativa allo sviluppo di un robot in grado di apprendere e immaginare il proprio corpo e capace di relazionarsi con questa immagine. Come molti sanno, l’immagine che abbiamo della nostra corporeità non è sempre accurata o realistica, ma è un’informazione importante che determina il modo in cui funzioniamo nel mondo. Quando cammini o giochi a palla, il tuo cervello pianifica costantemente il modo migliore di muovere il tuo corpo affinché tu non debba trovarti a urtare qualcuno, inciampare o cadere. Noi umani ci formiamo un modello del nostro corpo da bambini.

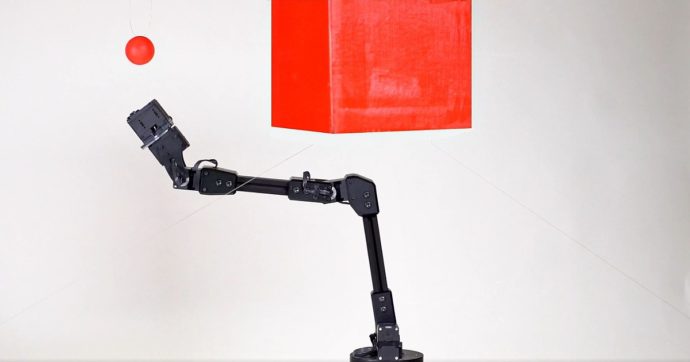

Ora un gruppo di ricercatori negli USA ha provato ad offrire questa stessa capacità ai robot. Un team di ricerca della Columbia University, Usa, ha annunciato oggi di aver creato un robot che, per la prima volta, è in grado di apprendere da zero un modello del proprio corpo, senza alcun aiuto umano. In un nuovo studio pubblicato su Science Robotics, i ricercatori hanno dimostrato come il loro robot sia riuscito a crearsi un modello cinematico di se stesso e quindi a utilizzare quello stesso modello personale per pianificare i propri movimenti, per raggiungere i propri obiettivi e per evitare gli ostacoli in una varietà di situazioni.

Per ottenere questi risultati, i ricercatori hanno posizionato il robot all’interno di un cerchio di cinque videocamere in streaming. Il robot ha iniziato a osservarsi attraverso le telecamere mentre si muoveva liberamente. Come un bambino che esplora se stesso per la prima volta in una sala degli specchi, il robot si dimenava e si contorceva per apprendere come si muovesse esattamente il suo corpo in risposta a vari comandi motori. Dopo circa tre ore, il robot si è fermato. La sua rete neurale profonda interna aveva finito di apprendere la relazione tra le sue azioni motorie e il volume che occupava nel suo ambiente.

“Eravamo davvero curiosi di vedere come si immaginasse il robot”, ha affermato Hod Lipson, professore di ingegneria meccanica e direttore del Creative Machines Lab della Columbia, dove il lavoro è stato svolto. “Ma non puoi semplicemente sbirciare in una rete neurale, è una scatola nera”. Dopo che i ricercatori hanno lottato con varie tecniche di visualizzazione, l’immagine del sé del robot è emersa gradualmente. “Era una sorta di nuvola tremolante che sembrava inghiottire il corpo tridimensionale del robot”, ha detto Lipson. La capacità dei robot di apprendere da solo un modello del proprio corpo senza essere assistiti dagli ingegneri è importante per molte ragioni: non solo consente di risparmiare manodopera, ma consente anche al robot di tenere il passo con la propria usura e persino di rilevare e compensare i danni. Un robot in fabbrica, ad esempio, potrebbe rilevare che qualcosa non si sta muovendo correttamente e compensare o richiedere assistenza.

“Noi umani abbiamo chiaramente una nozione del nostro sé”, ha spiegato il primo autore dello studio Boyuan Chen, che ha guidato il lavoro ed è ora professore alla Duke University. “Chiudi gli occhi e prova a immaginare come si muoverebbe il tuo corpo se dovessi fare qualche azione, come allungare le braccia in avanti o fare un passo indietro. Da qualche parte all’interno del nostro cervello abbiamo una nozione di noi stessi, un modello di noi stessi che ci dice quale volume delle nostre immediate vicinanze occupiamo col nostro corpo e come quel volume cambierà mentre ci muoveremo.” Ora si è ottenuto qualcosa di similare anche nel campo dell’intelligenza artificiale, hanno aggiunto i ricercatori. I quali, però, sono ben consapevoli dei limiti, dei rischi e delle controversie che circondano la concessione di una maggiore autonomia alle macchine. Ecco perché ci tengono a chiarire che il loro lavoro non ha portato neanche lontanamente a forme di autocoscienza dei robot o amenità similari. I tempi dei robot narcisisti sono ancora lontani.

Foto e video: Jane Nisselson e Yinuo Qin/ Columbia Engineering

Gianmarco Pondrano Altavilla