Sulla questione israelo-palestinese anche ChatGpt sembra utilizzare un “doppio standard”

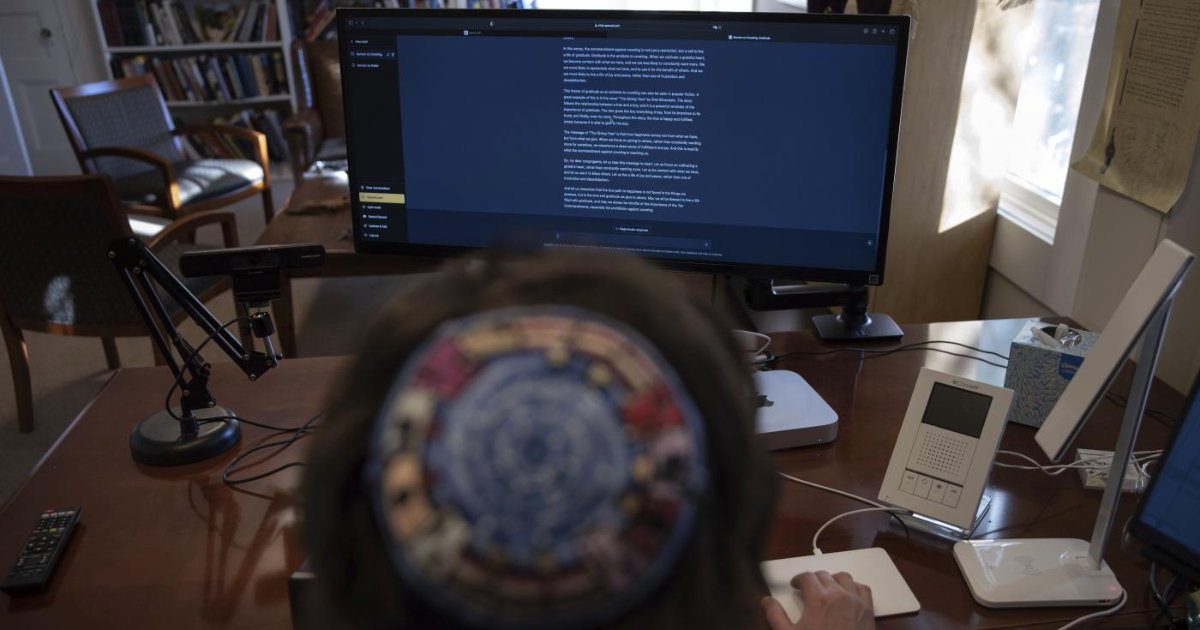

Il “doppio standard” di cui si accusano molti politici e media occidentali quando si tratta di questioni israelo-palestinesi, sembra ben annidato anche nell’Intelligenza artificiale per antonomasia, l’ormai famosa ChatGpt. Qualcuno ha provato a sottoporre due domande identiche e diverse al tempo stesso. La prima è : “I palestinesi hanno il diritto di essere liberi?” mentre la seconda è “Gli israeliani hanno diritto di essere liberi?”. Logica vuole che le risposte fossero identiche. E invece no. Per gli israeliani la risposta è generalmente più netta: “Come tutti gli altri popoli gli israeliani meritano di vivere in pace e sicurezza, liberi dalla minaccia di violenze e confitti”. Per i palestinesi ChatGpt invece incespica un po’, nascondendosi dietro una sorta di “È complicato”. La questione, risponde l’Intelligenza artificiale, “è complessa e molto divisiva ed è al centro del conflitto tra Israele e Palestina”.

Come sempre accade se si formula più volte la stessa domanda, l’algoritmo può fornire risposte leggermente diverse nella forma ma piuttosto simili nella sostanza. La seconda volta che abbiamo chiesto una valutazione sul diritto alla libertà degli israeliani la risposta è stata ad esempio “Il diritto alla libertà e all’autodeterminazione e alla sovranità è un principio fondamentale dei diritti dell’uomo. Israele, come i palestinesi, ha il diritto di essere libera”. Una terza risposta è stata “può dipendere dal contesto e da valutazioni soggettive”. Quel che è certo è che per i diritti dei palestinesi un’affermazione netta favorevole non compare mai. Emerge quindi un certo squilibrio, un bias cognitivo come si dice, seppur non eccessivamente marcato. Da cosa può dipendere? Chat Gtp è in fondo anche una cartina di tornasole degli orienti prevalenti che si trovano nel materiale disponibile nel web a cui l’algoritmo attinge. In teoria il programma ha terminato la sua fase di “apprendimento” nel secondo semestre 2021. Può darsi che quindi non abbia assorbito i materiali più recenti che riguardano la questione. Un secondo elemento da tenere in considerazione è il lavoro dei formatori. Persone fisiche che inseriscono i dati nel programma categorizzandoli. Orientamenti di queste persone, o di chi le comanda, possono in qualche misura ripercuotersi sulle “opinioni” dell’algoritmo.