L’Intelligenza Artificiale trasforma una foto in una persona che parla e canta

Un nuovo sviluppo delle Intelligenze Artificiali è divertente e inquietante allo stesso tempo. Grazie all'apprendimento e alle reti neurali è possibile partire da una foto e da una registrazione audio e animare una persona, facendole pronunciare frasi che non ha mai detto. Per fortuna al momento il trucco si vede.

Riuscite a immaginare Grigorij Rasputin, mistico influente consigliere dei reali di Russia, che canta la hit Halo della popstar Beyonce? Certo, è un fake. Ma di grande effetto. È la dimostrazione di una nuova frontiera dell’Intelligenza Artificiale, nell’ambito della stessa branca di sviluppo che ha portato alla creazione del suggestivo tool web ThisPersonDoesNotExist e della sua declinazione sul mondo animale PetSwap. Nei due casi citati il computer, debitamente addestrato, crea persone che non esistono, ma realistiche quanto quelle in carne e ossa, o modifica il muso degli animali mescolando caratteristiche di razze differenti.

La prossima frontiera è partire da una foto e animarla, facendo anche parlare (o cantare) la persona ritratta. Ci stanno lavorando i ricercatori del Samsung AI Center e dell’Imperial College di Londra, con risultati ancora imperfetti ma comunque stupefacenti. Per avere un’idea di concreta del grado di sviluppo della tecnologia date un’occhiata al video in cui Albert Einstein discute di Scienza:

Per realizzarlo sono state usate una sua foto pubblica e la sua voce, tratta da una registrazione storica. Ancora più inverosimile è vedere Grigorij Rasputin che canta Halo di Beyonce:

Dopo un primo momento di stupore e divertimento si noterà che le immagini sono sgranate e di bassa qualità, ed è evidente la manipolazione che ha portato all’animazione. Difficilmente qualcuno prenderà per veri questi video. Mancano i micro movimenti del viso che caratterizzano l’espressività di una persona mentre parla o canta, come ad esempio le piccole rughe che si formano vicino al naso e alle labbra. Inoltre, gli occhi sono poco brillanti. Se però consideriamo che la tecnologia ha realizzato questi risultati partendo da una sola immagine storica e da un file audio, non è male. È più che sufficiente per capire il potenziale, positivo e negativo, di quello che bolle in pentola. Prima di passare alle considerazioni però vediamo come si è arrivati a ottenere questi video falsi.

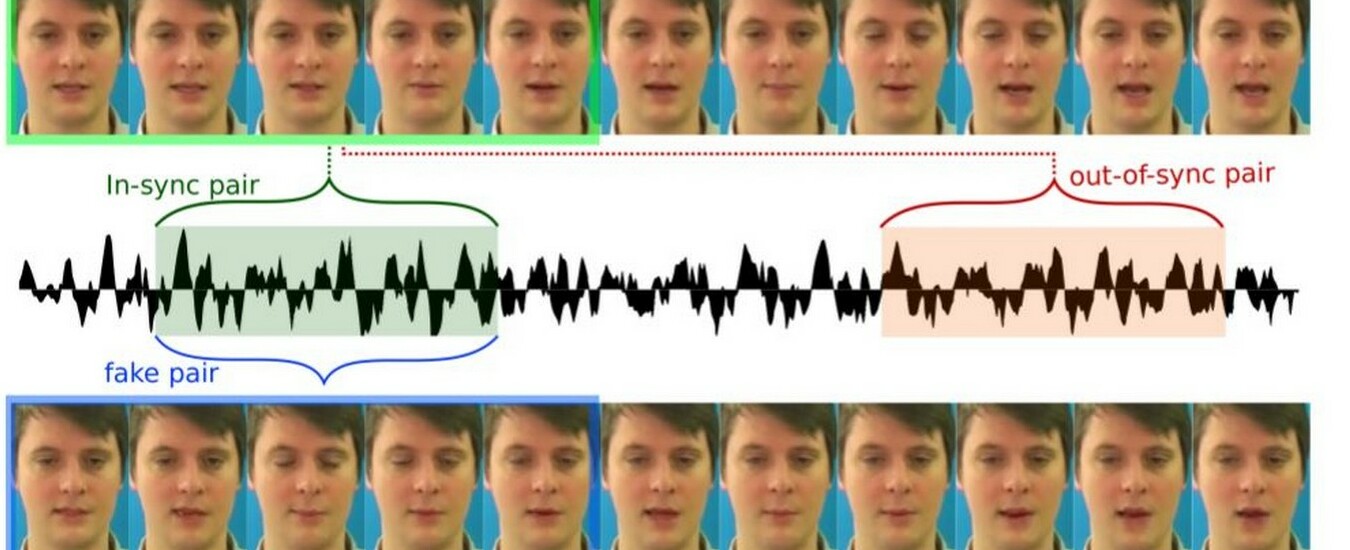

Stupirà sapere che il lavoro non è frutto di una scoperta o di una tecnologia rivoluzionaria, ma di qualcosa che esiste da tempo, e che è stato inventato da Nvidia per rendere più realistici i videogame. Ed è la stessa base di partenza da cui si sono sviluppati i sopraccitati ThisPersonDoesNotExist e PetSwap. È una rete neurale di tipo GAN (Generative Adversarial Network), ossia una soluzione informatica che imita la rete neurale umana predisponendo quanti più neuroni artificiali in collegamento fra loro. A differenza dei due casi precedenti, per i video sono impiegate tre intelligenze artificiali invece che due. Una (il generatore) produce flussi di materiale partendo da un’immagine e da una sorgente audio. Le altre due (discriminatori) cercano di distinguere tra video reali e falsi “basati sulla sincronia o sulla presenza di espressioni facciali naturali”, stando a quanto si legge nel documento divulgato.

I modelli sono stati addestrati con la classica tecnica di apprendimento delle Intelligenze Artificiali, impiegando 164.109 campioni prelevati da quattro serie di dati di persone che parlano, e 17.753 clip sono stati utilizzati per il test. I brevi fotogrammi realizzati dal generatore sono stati passati al primo discriminatore, che ha verificato che il labiale fosse coordinato il più possibile con l’audio. I file promossi sono stati dati in pasto a un secondo discriminatore, che ha guardato il video nel suo complesso per verificare se il passaggio tra un fotogramma e il successivo fosse scorrevole, in modo che il video apparisse realistico. La ricerca proseguirà con l’obiettivo di generare video sempre più realistici e convincenti.

A questo punto sorge il problema etico: come verrà impiegata questa tecnologia? Osservate il video sottostante: ci sono persone comuni, contemporanee, che pronunciano frasi che non hanno mai detto nella realtà.

E’ abbastanza per capire che persone comuni potrebbero essere manipolate, con tutto quello che ne segue, dalla diffusione di false notizie alla deposizione di testimonianze che accusano persone di crimini che non hanno commesso, tutto automaticamente, con la semplice pressione di pochi pulsanti. Vedere Marilyn Monroe che torna a recitare è emozionante, vedere noi stessi che confessiamo un omicidio (a nostra insaputa) non lo è affatto.